De trân nguyễn | Prensa asociada

Sacramento – Gavin Newsom, gobernador de California Modelos poderosos para la inteligencia artificial Para actividades potencialmente catastróficas, como construir un biowapfe o apagar un sistema bancario.

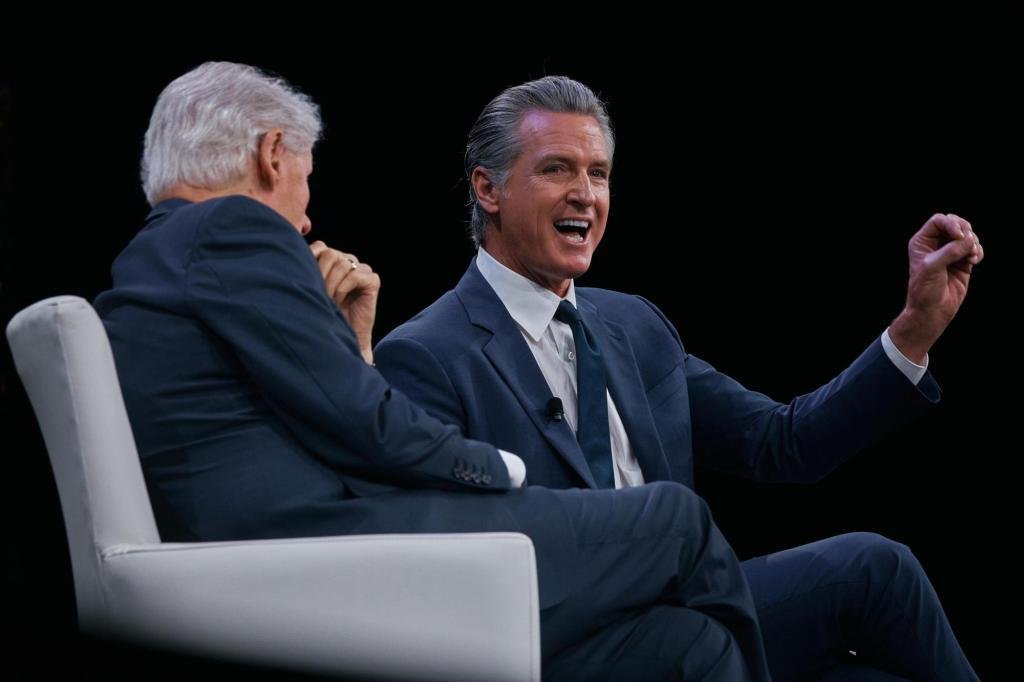

El paso se produce cuando Newsom California observó como líder en la regulación de la IA y criticó la inactividad a nivel federal en una conversación recientemente celebrada con el ex presidente Bill Clinton. La nueva ley determinará algunas de las regulaciones de primera clase para los modelos de IA a gran escala sin violar la industria nativa del estado, dijo Newsoma. Muchas de las principales compañías de IA del mundo están en California y deben cumplir con los requisitos.

“California ha demostrado que podemos determinar las regulaciones para proteger nuestras comunidades y al mismo tiempo garantizar que la creciente industria de IA continúe prosperando. Esta legislación cumple con este equilibrio”, dijo Newsom en una explicación.

En la legislación, las compañías de IA deben implementar y divulgar protocolos de seguridad pública para evitar que sus modelos más avanzados se utilicen para causar grandes daños. Las reglas están destinadas a cubrir los sistemas AI si cumplen con un casco “fronterizo” que indica que operan una gran cantidad de potencia informática.

Dichos valores de umbral se basan en cuántos cálculos realizan las computadoras. Aquellos que han creado las regulaciones han reconocido que los valores de umbral numéricos son un punto de partida incompleto para distinguir los sistemas de IA generativos de la próxima generación actual que podría ser aún más eficiente. Los sistemas existentes son fabricados en gran medida por empresas con sede en California, como Anthrope, Google, Meta Platforms y OpenAAI.

La legislación define un riesgo catastrófico como algo que dañaría al menos $ 1 mil millones o causaría más de 50 lesiones o muertes. Fue desarrollado para proteger la IA que se utiliza para actividades que pueden conducir a trastornos de masa, p. B. En una cuadrícula de potencia.

Las empresas también deben informar todos los incidentes críticos de seguridad al estado dentro de los 15 días. La ley crea protección contra denunciantes para los trabajadores de IA y crea una nube pública para los investigadores. Contiene una multa de 1 millón de dólares estadounidenses por violación.

Algunas compañías de tecnología se pusieron en oposición, lo que argumentó que la legislación de IA debería tener lugar a nivel federal. Anthrope, sin embargo, dijo que las regulaciones eran “medidas de protección práctica” que son las prácticas de seguridad que muchas empresas son ya lo haz voluntariamente.

“Si bien los estándares federales aún son esenciales para evitar un mosaico de regulaciones estatales, California ha creado un marco fuerte que trae seguridad pública con innovación continua”, dijo Jack Clark, cofundador y jefe de política de Anthrope.

La firma se lleva a cabo según Newsom en el último año, una versión más amplia de la legislación, que cambió con las compañías de tecnología, dijo que los requisitos eran demasiado rígidos y habían obstaculizado las innovaciones. En cambio, Newsom le preguntó a un grupo de varios expertos de la industria, incluido el pionero de IA Fei-Fei LiDesarrollar recomendaciones para barandas en términos de potentes modelos de IA.

La nueva ley contiene recomendaciones y comentarios del grupo de expertos de IA de Newsom y la industria, según los partidarios. La legislación tampoco tiene los mismos requisitos de informes para el inicio para evitar la innovación, dijo el senador Scott Wiener von San Francisco, autor de la ley.

“Con esta ley, California está aumentando nuevamente a medida que el proveedor mundial de innovación tecnológica y seguridad”, dijo Wiener en una explicación.

La decisión de Newsom se produce cuando el presidente Donald Trump ve un plan para remediar a su gobierno como regulaciones “estresantes” en julio para acelerar la innovación de IA y consolidar la posición de los Estados Unidos como un líder mundial de IA. Los republicanos en el Congreso a principios de este año intentaron sin éxito Prohibición de estados y lugares de la regulación de la IA por una década.

Sin regulaciones federales más fuertes, los estados de todo el país han tratado de contener la tecnología en los últimos años y tienen de todo, desde profundos en las elecciones hasta ataques. AI “Terapia”. En California, la Legislatura aprobó una serie de facturas este año para tener en cuenta las preocupaciones de seguridad con respecto a los chatbots de IA para los niños y el uso de IA en el lugar de trabajo.

California también fue un usuario temprano de tecnologías de IA. El estado tiene Herramientas de IA generativas preparadas utilizadas Reconocer incendios forestales y, entre otras cosas, abordar las atascos de las autopistas y la seguridad del tráfico.

El reportero de Associated Press Matt O’Brien contribuyó al informe.