Los padres están dando la alarma sobre los vídeos sexuales y violentos generados por IA que supuestamente YouTube recomienda a sus hijos.

Mamá Liz Guilar le dijo al Daily Mail que se vio “inundada” de contenido espeluznante después de abrir una cuenta para sus hijos de uno y tres años.

Ella dijo: “Las imágenes pueden ser aterradoras, con rostros derritiéndose, extremidades desapareciendo y monstruos creados accidentalmente que rivalizarían con Silent Hill, excepto que los niños pequeños son los que miran cuando sus padres confían en YouTube para seleccionar el contenido”. Da mucho miedo.’

Según el experto en inteligencia artificial Jeremy Carrasco, es probable que Guilar no esté solo en su experiencia y YouTube puede recomendar rutinariamente contenido terrible generado por inteligencia artificial a los niños.

Realizó un experimento que, según él, muestra que los clips perturbadores son generados por algoritmos típicamente dirigidos a niños.

Estos incluyen vídeos que muestran representaciones de dibujos animados de abuso infantil, pero también personajes de IA que se someten a operaciones grotescas, blanden armas, cometen actos de violencia o se comportan sexualmente.

Carrasco dijo que llegó a su conclusión creando una cuenta falsa y simulando los hábitos de transmisión de un niño en YouTube para probar qué tipos de videos serían recomendados.

Le dijo al Daily Mail: “YouTube se dio cuenta de que era un niño interesado en Bluey o Roblox y, sin embargo, los sugerían en la página de inicio”. Incluso las miniaturas de la página de inicio eran terriblemente horribles a veces”.

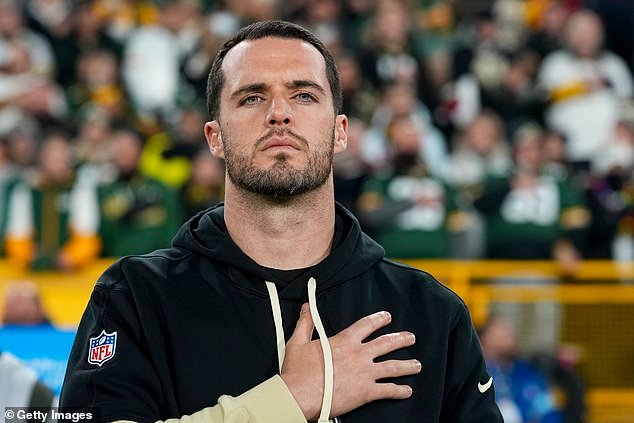

El productor de videos y consultor de inteligencia artificial Jeremy Carrasco dijo que creó una cuenta haciéndose pasar por un niño para ver qué tipo de contenido le enviaban.

Los inquietantes videos de IA en YouTube a menudo contienen personajes de animales humanoides. En este vídeo, una madre gata asfixia a su bebé con una almohada antes de arrojarlo por un acantilado

Afirmó que la página de inicio recomendaba de manera destacada contenido perturbador generado por IA desde el canal de cortos de YouTube del sitio, desde canales con nombres como “MeowBoom” y “MeowKitten007”.

YouTube le dijo al Daily Mail que ninguno de los videos reportados por el experimento de Carrasco apareció en la aplicación YouTube Kids, pero deshabilitó varios canales destacados por esa plataforma después de encontrar que violaban las pautas de la comunidad.

Jack Malon, portavoz de la plataforma, dijo al Daily Mail: “Para ser claros, este contenido no está incluido en la aplicación YouTube Kids”. “Los padres tienen control sobre lo que ven sus hijos en YouTube y deben seleccionar un nivel de restricción de contenido específico para la cuenta de su hijo durante la configuración”.

Carrasco dijo que incluso si estos inquietantes videos de IA no aparecen en la aplicación YouTube Kids, la versión normal de la plataforma aún debería poder saber si un niño los está viendo en función del contenido consumido.

“Creo que con algunas herramientas de envejecimiento deberían poder determinar: ‘Oh, oye, tenemos un niño de siete años mirando, probablemente no deberíamos poner cortometrajes en la página de inicio porque sabemos que eso es saludable'”, dijo.

“Ya tienen las herramientas para hacer esto”. Podrían hacerlo mañana. Ni siquiera estoy sugiriendo que bloqueen a estos usuarios para que no vean los vídeos cortos cuando los naveguen. Simplemente no les impongas algorítmicamente la mierda más dañina.

Los canales de cortometrajes generados por IA comenzaron a aparecer a finales del año pasado a medida que la tecnología se volvió más sofisticada.

En este vídeo de IA, una madre enojada con cabeza de oveja golpea a un gato con un bate y le vierte lo que parece alquitrán.

Desde entonces, decenas de canales se han beneficiado de vídeos de IA fáciles de crear con temas violentos, inquietantes y sexuales.

“Mi primera reacción fue pensar en lo terrible que habría sido si mis hijos hubieran visto solos”, dijo Guilar al Daily Mail.

“No creo que los niños pequeños puedan procesar lo que ven de la misma manera que los adultos, por lo que lo que para nosotros podría ser un error hilarante de la IA podría potencialmente confundir, asustar o incluso normalizar temas preocupantes”.

Guilar publicó una publicación en Reddit a principios de este año en la que dijo que estaba “realmente horrorizada al descubrir cuánta IA que derrite el cerebro hay, cosas francamente horribles”.

En el hilo, decenas de padres compartieron experiencias similares con la madre australiana y lamentaron la naturaleza dañina y perturbadora del contenido encontrado.

Un padre escribió: “Hace poco fui a una peluquera que tiene un estudio privado y ella trajo a su hija de 4 o 5 años porque cancelaron la escuela debido al clima y no me importó”.

“Pero luego les puso YouTube en la televisión y pasó TAN rápido de canciones y videos educativos a la basura de IA más extraña que jamás había visto”.

Otro padre dijo: “Algunos de ellos están realmente locos”. “Ojalá hubiera tomado capturas de pantalla del combustible de pesadilla que bloqueé”.

Los vídeos de IA también pueden contener personajes humanos. En esta película, una madre en pánico arroja a su bebé por la ventana de un avión que se estrella

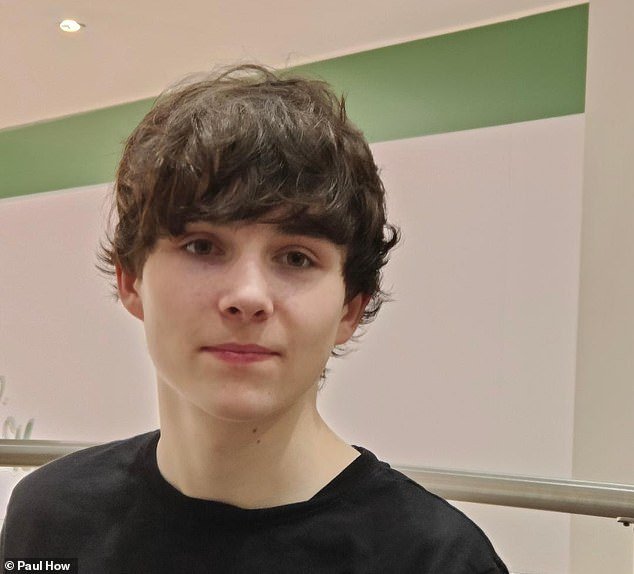

Liz Guilar quedó “horrorizada” por los inquietantes vídeos generados por IA que encontró en YouTube tras comprobar una cuenta que creó para sus hijos

Guilar también dijo que era “aterrador” imaginar a sus hijos viendo los videos de IA que encontró

Este grotesco vídeo que presenta una versión generada por IA del famoso futbolista Ronaldo tuvo especial éxito y recibió más de 200.000 me gusta.

Andrew Koepp, psicólogo del desarrollo y profesor asistente de psicología aplicada en la Universidad de Nueva York, explicó al Daily Mail el daño que este tipo de contenidos podría tener en los niños.

Dijo que las características superficiales de los “videos estaban claramente diseñadas para atraer a los niños con colores brillantes y personajes exagerados, parecidos a dibujos animados… Sin embargo, el contenido era claramente muy inapropiado para los niños”.

“Antes de los ocho años, los niños tienen dificultades para distinguir entre ficción y realidad”, dijo Koepp, añadiendo que los vídeos que le envió el Daily Mail para su revisión “tocan el abandono y las amputaciones de extremidades, temas que merecen un alto nivel de sensibilidad”.

La controversia sigue al escándalo “Elsagate” de YouTube a finales de la década de 2010, en el que los YouTubers utilizaron imágenes de personajes infantiles como Elsa o Spiderman de “Frozen” para recrear escenarios inapropiados con temas violentos y sexuales.

Los videos tuvieron un buen desempeño porque sus creadores incluyeron los nombres de los personajes en el título y las etiquetas, lo que provocó que el algoritmo los promocionara entre los niños.

El doctor Kostantinos Papadamou, informático e investigador, estudió el fenómeno Elsagate y publicó un artículo al respecto en 2020.

El abuso físico de niños es un tema común en estos videos generados por IA

Algunos de los vídeos contienen sangre e imágenes inquietantes de lesiones.

El problema actual de los videos perturbadores de IA es la última entrega de un problema de larga data con YouTube que recomienda videos inapropiados a los niños. Estas capturas de pantalla son de vídeos que formaron parte de la controversia “Elsagate” a finales de la década de 2010.

En el estudiarÉl y su equipo simularon el comportamiento de un niño en YouTube y descubrieron que “hay un 3,5 por ciento de posibilidades de que un niño pequeño que sigue las recomendaciones de YouTube encuentre un video inapropiado dentro de diez (clics) cuando comienza con un video que aparece entre los diez primeros resultados de una búsqueda de palabras clave para niños pequeños”.

YouTube ha realizado cambios en la plataforma para abordar el problema de Elsagate.

Se agregó una función que requería que cualquiera que publicara en el sitio hiciera clic en un cuadro que indicaba si el video estaba destinado a niños, lo que ayudó a aliviar el problema.

Al establecer conexiones entre Elsagate y el problema actual con el contenido inapropiado de IA, Papadamou le dijo al Daily Mail que le preocupaba lo fácil que era crear estos nuevos e inquietantes videos de IA.

“El problema era bastante grande en 2020 con la cantidad de vídeos que solíamos tener, y no podían seguir el ritmo porque la mayoría de las medidas estaban vinculadas a un ser humano”, dijo.

“Se puede imaginar que estas medidas ya no pueden seguir el ritmo del volumen actual”.