Los padres de un adolescente del área de Seattle que supuestamente fue presionado para quitarse la vida por un miembro de la red extremista en línea 764 presentaron una demanda por muerte por negligencia contra Discord, alegando que el gigante de las redes sociales “causó” el suicidio de su hijo y “facilitó una de las sectas de abuso infantil más depravadas y peligrosas de la historia moderna”.

Según la demanda, Discord proporcionó “764 víctimas ilimitadas”, incluido Jay Taylor, de 13 años, que murió en enero de 2022. murió por suicidio afuera de uno Tienda de comestibles local en Gig Harbor, Washington.

“Lo que pasó es casi bíblico en su definición de maldad”, dijo Colby, el padre de Jay Taylor, en una entrevista exclusiva con ABC News en noviembre.

Como informó anteriormente ABC News, 764 miembros encuentran víctimas vulnerables en plataformas populares, extraen de ellas información privada e imágenes sexuales íntimas y luego utilizan este material sensible para chantajear a las víctimas para que se mutilen, dañen a otros o tomen otras acciones violentas.

Los miembros de 764 suelen organizar chats en vivo en línea para que otros puedan seguir la autolesión y la violencia en tiempo real. Cuanto más puedan presionar a sus víctimas, más prestigio y respeto recibirán dentro de 764, dicen las autoridades.

Las cenizas de Jay Taylor, de 13 años, reposan en un columbario en Gig Harbor, Washington

ABC Noticias

“Discord proporcionó a 764 acceso a su plataforma, no tomó medidas razonables para prevenir o interrumpir dicha explotación y mantuvo el mismo diseño de producto y configuración predeterminada que permitieron el abuso”, afirma la nueva demanda de 31 páginas.

Colby Taylor le dijo anteriormente a ABC News que él y su esposa Leslie estaban preparando una demanda contra Discord, con la esperanza de que una acción legal presionaría a la plataforma a hacer más para detener a los depredadores en línea. La demanda fue presentada el jueves en un tribunal del condado de Pierce, Washington, y buscaba daños y perjuicios no especificados.

Como lo describieron los Taylor a ABC News, Jay Taylor era una víctima vulnerable. Era “divertido” y “dulce” y tenía una habilidad especial para dibujar y hacer manualidades, recordó su madre. Pero cuando comenzó el 2021, Jay se sintió aislado y solo debido a la pandemia de COVID-19. Y aunque le asignaron mujer al nacer, estaba en medio de una transición de género, lo que aumentó sus sentimientos de soledad, dijeron sus padres.

Leslie y Colby Taylor, padres de Jay Taylor, hablan con el presentador de ABC News, Juju Chang, sobre su difunto hijo y los peligros del 764.

ABC Noticias

En enero de 2022, Jay publicó un mensaje en Discord que decía: “Estoy buscando amigos, preferiblemente amigos de crochet LGBTQ”, recuerda el padre de Jay.

Alguien respondió al mensaje de Jay y lo puso en un chat en vivo con varias personas más. Aproximadamente una hora después, otros en el chat grupal comenzaron a decirle a Jay que se suicidara, dijeron los padres de Jay.

Según los padres de Jay, un usuario de Discord que se hacía llamar “Tigre Blanco” en línea fue el líder de la acusación y dirigió a otros para presionar y manipular a Jay.

“Al final, la presión llegó a Jay”, dice la demanda.

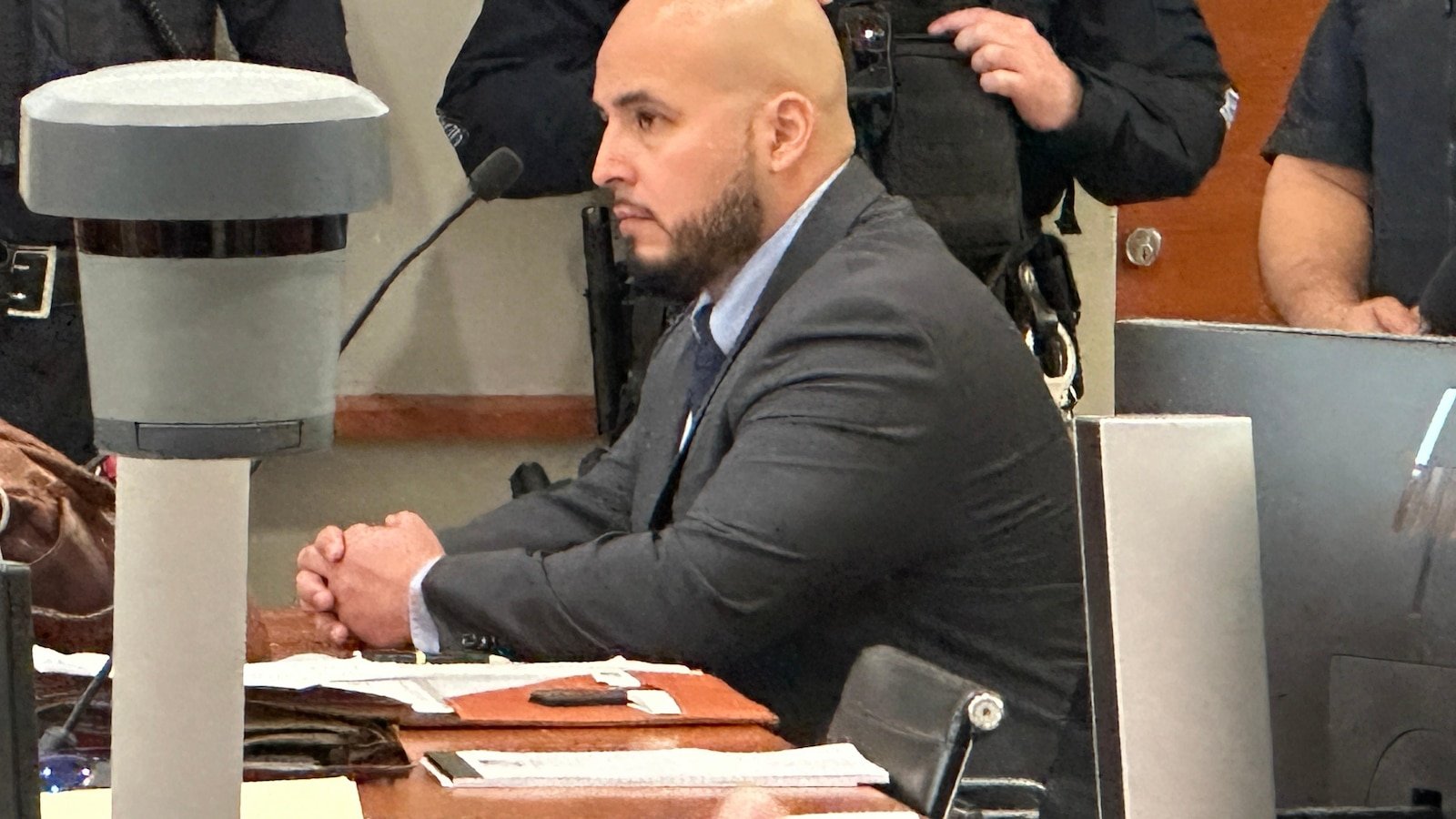

Posteriormente, el FBI identificó al “Tigre Blanco” como un joven estudiante de medicina alemán-iraní de Hamburgo. Actualmente se encuentra siendo juzgado en Hamburgo, acusado del asesinato de Jay Taylor y de más de 200 cargos más por supuestamente maltratar a decenas de víctimas. Según la demanda de los Taylor, Discord plantea “un riesgo previsible de daño a los usuarios jóvenes” y “no es razonablemente seguro como se esperaba”.

“Desde el principio, Discord diseñó una plataforma que estaba estructuralmente plagada de características obvias que amplificaban el riesgo, y cuando esos riesgos se materializaron a través de 764, Discord los alojó, los desarrolló y, mientras tanto, se comercializó entre más usuarios infantiles y garantizó su explotación”, dice la demanda.

La demanda alega además que Discord “se niega a invertir en medidas de seguridad razonables” e “intencionalmente carece de personal y de personal insuficiente en su equipo de seguridad y respuesta, utilizando sólo una pequeña fracción de lo que es necesario para controlar eficazmente el comportamiento abusivo”.

764 fue fundado en Discord por un adolescente en Stephenville, Texas, quien lo nombró según los primeros tres dígitos de su código postal local. 764 surgió en medio de la pandemia de COVID-19, cuando los adolescentes atrapados en el interior acudieron en masa a los espacios en línea. Las autoridades dijeron que 764 era una rama aún más cruel de otros grupos en línea que explotaban a niños mediante la extorsión y la autolesión.

Desde entonces, 764 se ha extendido por todo el mundo, convirtiéndose en una ideología en lugar de un grupo único, dicen los expertos. Y otros grupos, inspirados en 764, se han formado con nombres diferentes pero tácticas y objetivos idénticos. En noviembre, el FBI investigó a más de 350 personas en Estados Unidos con presuntos vínculos con 764 o redes similares.

Según los expertos, la cifra no ha hecho más que aumentar desde entonces. El martes, el presidente del Comité de Supervisión y Reforma Gubernamental de la Cámara de Representantes, James Comer, republicano por Kentucky, envió una carta al director del FBI, Kash Patel, pidiendo a los funcionarios del FBI que informaran al personal del comité sobre los esfuerzos de la agencia para “rastrear y arrestar” a los miembros del 764.

Una fotografía sin fecha encontrada por la policía en Vernon, Connecticut, en los dispositivos de una joven de 17 años asociada con la red en línea 764 muestra una muñeca Barbie con la etiqueta “764”.

Departamento de policía de Vernon

Citando un informe de ABC News, Comer escribió que las “tácticas inquietantes atribuidas a esta red” requieren “una estricta supervisión y una evaluación de si las contramedidas federales existentes son efectivas y cuentan con los recursos adecuados para combatir a estos esquivos perpetradores en línea”.

En septiembre, Patel dijo a los legisladores durante una audiencia pública en el Senado que luchar contra 764 era ahora una “prioridad” para el FBI. Llamó a los crímenes relacionados con 764 una nueva forma de “terrorismo moderno en Estados Unidos”.

El viernes, un portavoz de Discord dijo que la compañía lo estaba investigando. la nueva demanda presentada por Colby y Leslie Taylor.

Después de que ABC News entrevistó a los Taylor hace varios meses, un representante de Discord le dijo a ABC News en un comunicado que la plataforma está “comprometida con la seguridad de los usuarios” y que las “horribles acciones de tales grupos no tienen cabida en Discord ni en ningún lugar de la sociedad”.

Según un portavoz de Discord, la plataforma está invirtiendo “fuertemente” en equipos especializados y herramientas de inteligencia artificial recientemente desarrolladas que pueden “interrumpir estas redes, eliminar contenido infractor y tomar medidas contra los malos actores en nuestra plataforma”.

Discord también dijo que comparte información con otras plataformas, lo que puede ayudar a identificar actores maliciosos antes de que Discord los descubra, y Discord dijo que está trabajando con las autoridades y brindándoles consejos y otra información de manera proactiva.

Sus pistas dieron lugar a numerosos arrestos, incluido el arresto de Bradley Cadenhead, el adolescente de Texas que inició 764 y ahora cumple una sentencia de 80 años en una prisión estatal después de declararse culpable de cargos relacionados con pornografía infantil. Y Discord anunció recientemente nuevas herramientas diseñadas para brindar a los padres más control y conocimiento de las cuentas de sus hijos.