(Bloomberg/Ian King) — Los muy esperados nuevos productos de centro de datos Ruby de Nvidia Corp. están a punto de lanzarse este año y los clientes pronto podrán probar la tecnología para acelerar el desarrollo de la IA.

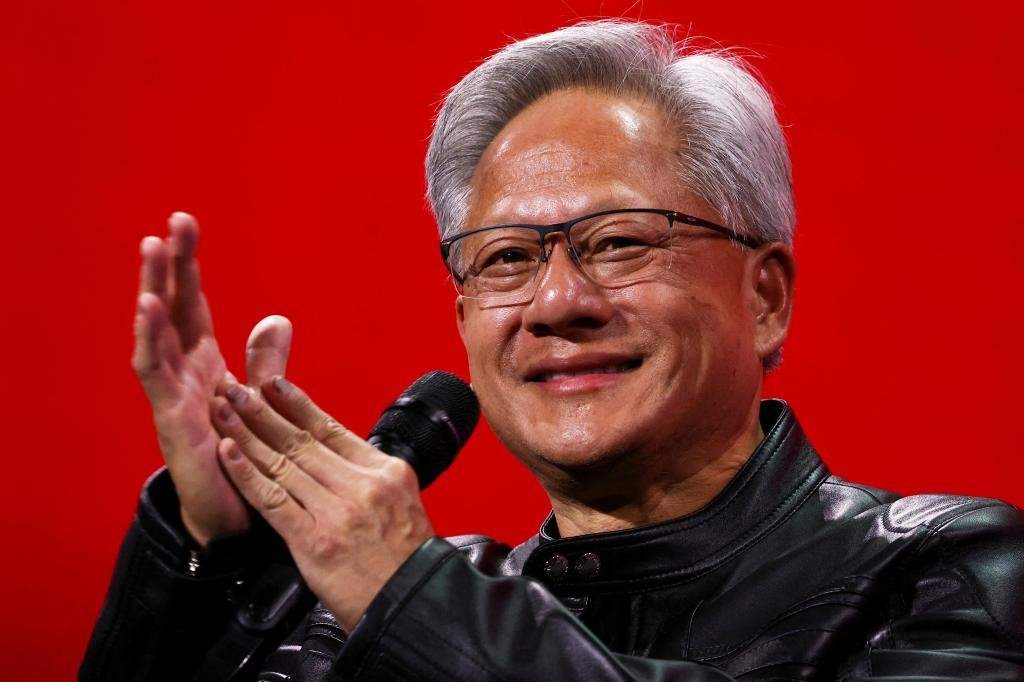

Los seis nuevos chips Ruby regresaron de los socios de fabricación y ya pasaron algunas pruebas importantes que muestran que están en camino de ser implementados por los clientes, dijo Nvidia. El director ejecutivo, Jensen Huang, presentó los productos durante una presentación principal en la feria CES en Las Vegas el lunes.

“La carrera por la IA ha comenzado”, afirmó. “Todos están tratando de pasar al siguiente nivel”.

Los comentarios de Huang indican que Nvidia mantiene su liderazgo como fabricante líder de aceleradores de inteligencia artificial, los chips utilizados por los operadores de centros de datos para desarrollar y ejecutar modelos de inteligencia artificial.

Rubin es el acelerador más nuevo de Nvidia y puede entrenar 3,5 veces mejor y ejecutar software de inteligencia artificial cinco veces mejor que su predecesor Blackwell, afirma la compañía. Una nueva unidad central de procesamiento tiene 88 núcleos -los principales elementos de procesamiento de datos- y ofrece el doble de rendimiento que el componente al que reemplaza.

La compañía está anunciando detalles de sus nuevos productos antes de lo habitual, como parte de un intento de encerrar a la industria en su hardware, lo que ha llevado a una explosión en el uso de la IA. Nvidia normalmente entra en detalles del producto en su evento GTC de primavera en San José, California.

Para Huang, CES es otra parada en su maratón de apariciones en eventos donde anuncia productos, colaboraciones e inversiones, todos destinados a promover el uso de sistemas de IA. Su homóloga del competidor más cercano de Nvidia, Lisa Su de Advanced Micro Devices Inc., dará una presentación principal en la feria el lunes más tarde.

Algunos en Wall Street han expresado su preocupación de que la competencia por Nvidia esté aumentando y que el gasto en IA no pueda continuar al ritmo actual. Los operadores de centros de datos también están desarrollando sus propios aceleradores de IA. Sin embargo, Nvidia mantiene sus previsiones optimistas a largo plazo, que apuntan a un mercado global del tamaño de un billón de dólares.

El nuevo hardware, que incluye componentes de red y conectividad, será parte de la supercomputadora DGX SuperPod, pero también estará disponible como productos independientes para los clientes para un uso más modular. El aumento del rendimiento es necesario a medida que la IA ha pasado a redes de modelos más especializadas que no sólo necesitan examinar cantidades masivas de información, sino también resolver problemas específicos a través de procesos de varios pasos.

La compañía enfatizó que los sistemas basados en Ruby son más baratos de operar que las versiones de Blackwell porque ofrecen los mismos resultados con una menor cantidad de componentes. Microsoft Corp. y otros importantes proveedores de informática remota estarán entre los primeros en implementar el nuevo hardware en la segunda mitad del año, dijo Nvidia.

Actualmente, la mayor parte del gasto en computadoras basadas en Nvidia proviene de los presupuestos de capital de un puñado de clientes, incluidos Microsoft, Google Cloud de Alphabet Inc. y AWS de Amazon.com Inc. Nvidia está impulsando software y hardware destinados a ampliar la adopción de la IA en toda la economía, incluida la robótica, la atención sanitaria y la industria pesada.

Como parte de este esfuerzo, Nvidia anunció un conjunto de herramientas diseñadas para acelerar el desarrollo de vehículos y robots autónomos.

Para más historias como esta, consulte Bloomberg.com

©2026 Bloomberg LP